Embodied Space Studio[具身空间工作室]-V1.0.0

今天想和大家分享一个正在探索中的项目,叫做 Embodied Space Studio。

这个项目并不是从零开始发明一套动作生成模型。它的基础,来自 NVIDIA Research 的 Kimodo 项目。Kimodo 是一个面向运动生成的研究项目,主要能力是通过文本提示词和约束条件,生成高质量的人体或机器人动作。它本身已经展示了很强的研究价值和技术潜力。

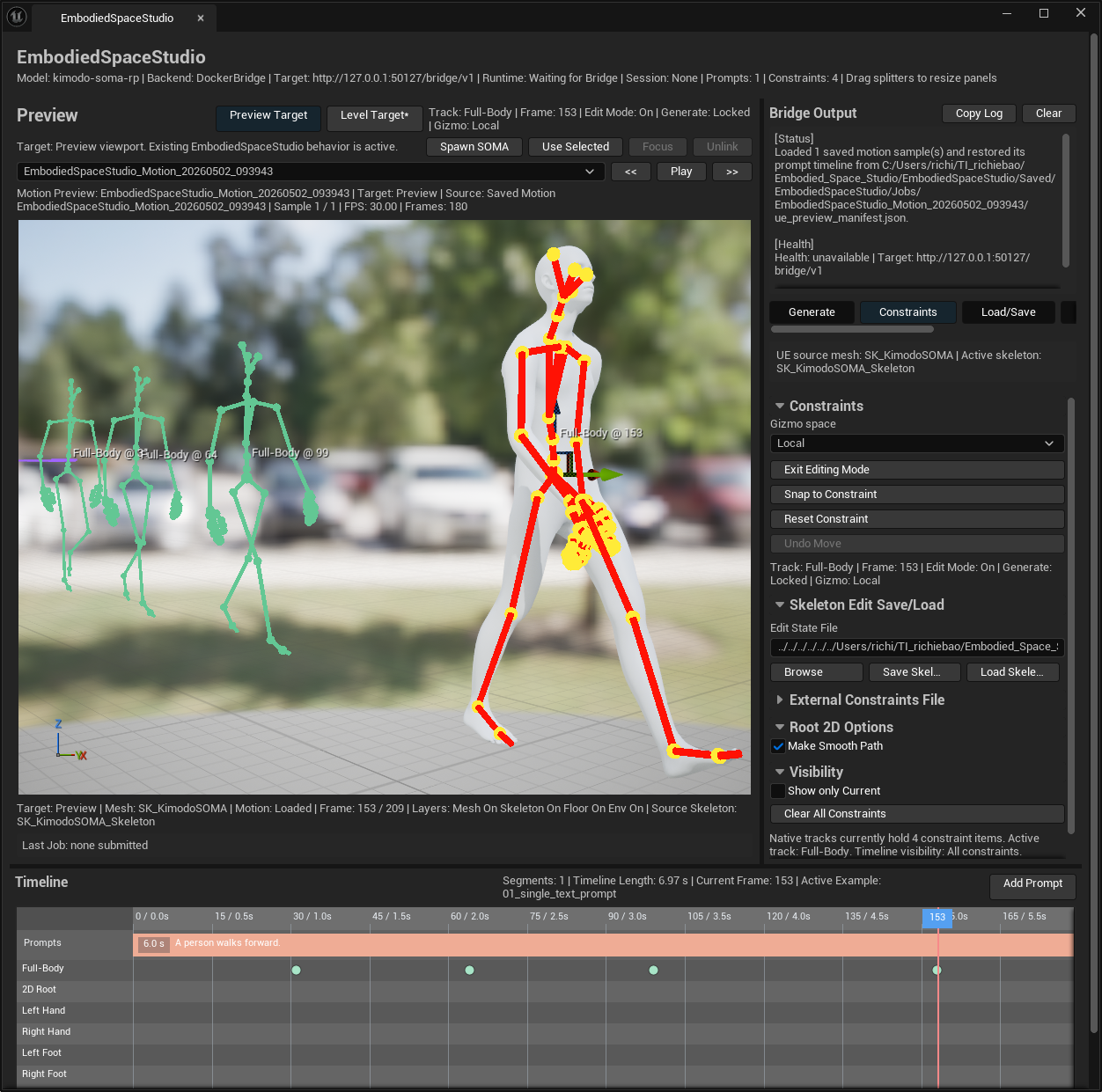

我们现在做的事情,是尝试把 Kimodo 的能力迁移到 Unreal Engine 平台中,并把它封装成一个可以在 UE 编辑器里使用的插件。换句话说,我们希望让 AI 动作生成不只是停留在独立演示或外部工具里,而是能够进入真实的引擎工作流,和场景、角色、骨骼、动画资产以及关卡编辑结合起来。

当然,这还是一个持续迭代中的工作。我们并不认为它已经是一个完整成熟的商业化工具。更准确地说,它是一个研究型和生产型之间的桥梁实验:一边保留 Kimodo 在动作生成方面的能力,一边探索它在 Unreal Engine 生态里的实际使用方式。

在目前的版本里,创作者可以在 UE 插件面板中输入文本提示词,系统会通过后端服务调用 Kimodo 相关模型,生成对应的动作数据。生成完成后,动作可以回到 Unreal Engine 中进行预览,而不是只存在于外部程序里。

这一步看似简单,但对实际工作流很关键。因为动作是否合适,不能只看单独的骨架动画,还要看它放进场景之后,和角色比例、地面、障碍物、镜头、空间尺度是否协调。也正因为如此,我们在插件里设计了预览目标和关卡目标两种方式。

预览目标适合快速查看生成结果,判断动作本身是否接近预期。关卡目标则更进一步,可以把动作带到 UE 的 Level 视口中,结合真实场景进行观察和调整。这样,动作生成就不再是一个孤立的按钮,而是可以逐渐融入场景创作、空间验证和交互设计。

除了文本生成,项目也在尝试支持约束编辑。所谓约束,可以理解为创作者对动作提出的具体要求。比如某一帧手要到达某个位置,身体需要保持某种姿态,或者角色需要按照某个空间方向运动。系统会把这些约束整理成模型可以理解的数据,再让生成过程尽量满足这些条件。

这类能力对游戏开发当然有价值。它可以帮助我们快速生成角色动作草稿,测试 NPC 行为,验证交互动画,或者为虚拟角色创建基础动作素材。但我们更感兴趣的,是它未来不只服务于游戏资产本身,而是扩展到更广泛的“人行为研究”。

比如在建筑空间研究中,我们可以用它模拟人在不同空间中的行走、停留、转身和避让行为。在人体工程学方向,它也可能帮助我们研究人在操作界面、家具、设备或工作环境时的身体姿态。在 NPC 和智能体研究中,这套系统也有进一步拓展空间。未来的 NPC 不应该只是沿着路径点移动,而是要表现出更接近人的行为逻辑。它需要理解空间、目标、动作和约束之间的关系。基于 Kimodo 的动作生成能力,再结合 UE 中的环境感知、行为树、导航系统和交互逻辑,或许可以探索更自然的虚拟角色行为。

在技术上,这个项目涉及多个层面的整合。前端是 Unreal Engine 编辑器插件,负责用户界面、时间线、预览视口和关卡交互。后端则连接 Kimodo 的推理能力,用于实际生成动作。中间还需要处理骨骼映射、动画预览、SOMA 骨架、UE 角色资产、IK Retargeter,以及生成结果到动画资产的转换。

这些工作听起来比较工程化,但它们正是让研究项目走向实际使用所必须面对的问题。一个 AI 模型本身很重要,但如果它不能稳定进入创作者熟悉的工作环境,就很难真正发挥长期价值。我们的目标不是包装一个炫目的演示,而是慢慢把它打磨成一个可以被研究者、设计师和开发者持续使用的工具。

所以,如果用一句话概括 Embodied Space Studio,它是一个基于 NVIDIA Research Kimodo 项目的 UE 插件化迁移尝试,希望把文本驱动和约束驱动的动作生成能力,带入 Unreal Engine 的实时场景中,并进一步服务于游戏开发、虚拟角色、人行为研究、建筑空间分析、人体工程学和 NPC 行为等更广泛的方向。

这个项目还在路上,也一定会有很多需要改进的地方。但正是这些具体的迁移、适配和迭代,让我们有机会看到 AI 动作生成从研究演示,逐步走向真实创作环境的可能性。未来,我们希望它不只是帮助生成动作,而是帮助我们更好地理解人在空间中的行动方式,以及虚拟角色如何在数字世界中更自然地存在。